- +在此添加单个AI新笔记

1

📌 置顶重要内容

🔥 新手必看精华

💡 基础入门指南

2

🐍 Python简介

🌱 入门第一步

👀 初识编程

3

💻 在线安装

⚡️ 快速开始

📶 网络依赖

4

💾 离线安装

🚫 无网络

📁 包管理

5

📦 PIP工具

🔧 自带库

🔄 包管理

6

💾 离线安装

🐍 PIP

📦 包管理

7

🔄 版本控制

🐍 多版本

💻 系统兼容

8

💻 VSCode

🔧 环境配置

🐍 Python

9

💻 PyCharm

🔧 环境配置

🐍 Python

10

📁 .gitignore

🔧 配置

🚫 忽略规则

11

📚 基础结构

🔧 分配建议

🐍 Python入门

12

🚪 程序入口

🔑 特殊变量

🐍 基础语法

13

📦 模块导入

➡️ 相对路径

🐍 包管理

14

📁 包标识

🏷️ 初始化

🐍 模块基础

15

👨🏫 类定义

📐 面向对象

🐍 基础语法

16

👨👦 类继承

🧬 面向对象

🐍 进阶语法

17

🔧 方法定义

📝 函数基础

🐍 入门必备

18

🔒 私有方法

🛡️ 封装特性

🐍 面向对象

19

📦 可变参数

🔧 函数进阶

🐍 高级特性

20

✨ 装饰器

🔒 只读属性

🐍 类技巧

21

🐍静态方法

类装饰器

基础语法

22

🐍类方法

cls参数

基础进阶

23

🐍装饰器

函数修饰

入门必备

24

🐍带参装饰

高级用法

灵活应用

25

✨内置方法

双下划线

核心特性

26

✨自定义

魔法方法

扩展功能

27

✨重写

类行为

面向对象

28

🔢整数

四则运算

基础类型

29

🔢浮点数

小数计算

数值操作

30

🔤字符串

文本处理

常用方法

31

📖 字符串基础

💡 数据类型

🐍 Python入门

32

🔤 格式化输出

⚙️ 类型转换

🐍 基础语法

33

📋 列表操作

🔧 增删改查

🐍 数据类型

34

🔒 元组特性

⚠️ 不可变性

🐍 数据结构

35

🔑 字典基础

📚 键值对

🐍 核心类型

36

📝 JSON操作

🔄 数据转换

🐍 数据交换

37

✂️ 切片技巧

📍 索引操作

🐍 序列处理

38

🖨️ 对象查看

🔍 属性探索

🐍 调试技巧

39

📁 文件读写

💾 数据存储

🐍 IO操作

40

🔎 类型检查

🧪 变量诊断

🐍 基础工具

41

📏 获取长度

✨ 基础方法

🐍 简单示例

42

⌨️ 输入方法

✨ 基础方法

📝 入门必备

43

🔍 类型检查

✨ 基础方法

✅ 基础判断

44

📊 排序数据

✨ 基础方法

🔢 数据处理

45

📝 字符串处理

✨ 基础方法

💬 文本格式

46

📦 模块导入

✨ 基础方法

🔗 扩展功能

47

📝 局部变量

✨ 基础方法

📊 查看变量

48

🔍 属性查询

✨ 基础方法

🔄 反射操作

49

📚 其他方法

✨ 基础方法

🔍 方法大全

50

🔄 类型转换

✨ 基础方法

💾 字节处理

51

🐍字符串转换

🔤编码基础

📚入门必备

52

📋列表转换

🔢序列基础

🎯初学者

53

🔄容器互转

🏷️元组列表

🐣基础教程

54

📊数据处理

🐼Pandas

🧠数据转换

55

📚字典基础

🔄类型转换

🔑键值学习

56

📋列表处理

📊字典转换

🧩数据结构

57

🐼Pandas

📈数据分析

🔧数据转换

58

📊DataFrame

📖字典生成

🔍数据处理

59

📊数据创建

🐼Pandas基础

🔢元组转换

60

📜语句解析

🐍Python基础

🆒开始学习

61

🚀条件判断

🎯if/else

✅初学者

62

🔄循环遍历

📊数据处理

🐍基础语法

63

🔁循环控制

⏱️条件循环

✨基础概念

64

🛡️异常捕获

🤔错误处理

✅安全尝试

65

📁资源管理

🧠上下文

🔐自动关闭

66

🔙函数返回

📤输出结果

🏁结束标记

67

❗主动异常

⚠️错误提示

💥中断执行

68

🏗️环境隔离

🔧工具使用

🐍虚拟环境

69

🖥️系统操作

📂文件管理

📍路径处理

70

⚙️解释器设置

🔧系统交互

🐍环境变量

71

📖 正则表达式基础

🔍 模式匹配入门

🐍 Python库

72

⏱️ 时间处理基础

📅 日期时间函数

🐍 Python库

73

📅 日期时间对象

⏳ 时间差计算

🐍 Python库

74

🧮 数学运算入门

📐 几何函数

🐍 Python库

75

📄 XML解析基础

🌲 树形结构处理

🐍 Python库

76

📧 邮件发送教程

🔐 SMTP协议

🐍 Python库

77

⚡ 异步编程基础

🔄 协程入门

🐍 Python库

78

📋 复制对象教程

🔄 深浅复制区别

🐍 Python库

79

🔒 加密安全入门

🔑 HMAC验证

🐍 Python库

80

🔒 文件锁定基础

📁 并发控制

🐍 Python库

81

🚀 多进程基础

🐍 简单易学

🔧 内置库

82

📝 日志记录

🐍 简单易学

🔧 内置库

83

🌐 网络请求

🐍 简单易学

🔧 内置库

84

📥 视频下载

🛠️ 命令行

🐍 Python工具

85

📦 虚拟环境

🐍 环境隔离

🛠️ 必备工具

86

🧩 依赖管理

📊 依赖树

🐍 Python库

87

🔌 JS互操作

🐍 Python调用

🌐 JavaScript

88

🗄️ 数据库

🐍 Python连接

🔌 MySQL

89

🐞 调试工具

🛠️ 装饰器

🐍 高级Print

90

🖱️ 鼠标控制

⌨️ 键盘控制

🤖 自动化

91

📝文档处理

🐍基础入门

💻办公自动化

92

📊数据处理

🐍基础入门

💻办公自动化

93

🌐网络请求

🐍基础入门

🆚版本差异

94

🌐网络请求

🐍基础入门

🔐安全连接

95

🌐网络请求

🐍基础入门

✨简单易用

96

🌐网络请求

🐍基础入门

🔒证书认证

97

🤖自动化测试

🐍基础入门

🌐网页操作

98

🤖自动化测试

🐍基础入门

🚦浏览器驱动

99

🔍HTML解析

🐍基础入门

📃文本处理

100

🔍中文分词

🐍基础入门

📚文本分析

101

🐍基础语法

🔤中文处理

📖入门教程

102

🗃数据库

🐍PyMySQL

📚基础知识

103

🐍类封装

🗃数据库

🔧编程技巧

104

🔄增删改查

🐍PyMySQL

📊数据库操作

105

🗑删除数据

🐍数据库

⚠️谨慎操作

106

🔴Redis集群

🐍redis-py

📦缓存技术

107

📁MongoDB

🐍pymongo

🗄NoSQL

108

🔒安全审计

🐍bandit

🛡代码安全

109

🌲树形结构

🐍anytree

📊数据结构

110

🛡杀毒引擎

🐍pyClamd

🖥系统安全

111

📦 打包工具

🐍 程序分发

🔧 实用技巧

112

⏱ 定时任务

🌐 分布式

💡 进阶技术

113

🐇 消息队列

🔌 连接管理

🔄 异步处理

114

⚡ 异步编程

🕒 并发处理

🌟 核心模块

115

🌍 多语言

📚 API调用

🛠 工具使用

116

🧩 模块设计

💻 编程基础

🎯 项目实践

117

🌐 Web框架

🔗 路由处理

📡 请求响应

118

📡 HTTP请求

🔗 接口调用

📊 数据处理

119

🧮 逻辑计算

⚙️ 服务层

📈 业务处理

120

💾 数据库

🐬 MySQL

📊 数据访问

121

🐍入门教程

🕸️爬虫基础

📷图片采集

122

🔧工具使用

💾数据库设计

📄文档生成

python beautifulsoup4 HTML解析库

beautifulsoup4库的简介

Python 的 BeautifulSoup4 库是一个用于解析HTML和XML文档的库。它能够从网页中提取数据,生成解析树,从而便于提取、修改和操作网页内容。BeautifulSoup4 提供了简单的方法来导航、搜索和修改解析树,支持多种解析器,如 html.parser 和 lxml。它广泛应用于网页抓取、数据提取、内容分析等场景,是处理网络数据和实现网络爬虫的重要工具。

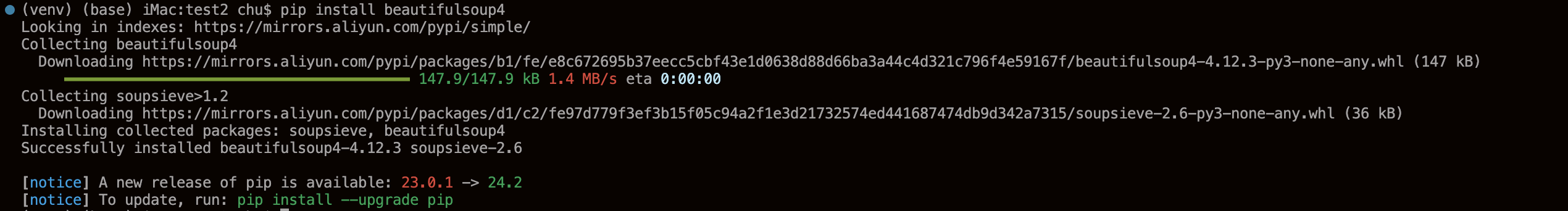

安装html解析库 beautifulsoup4

pip install beautifulsoup4

可以看见不仅仅安装了beautifulsoup4库还安装了soupsieve

Soupsieve 是一个现代的 CSS 选择器库,专为 Beautiful Soup 4 设计,用于在 Python 环境中使用现代 CSS 选择器进行选择、匹配和过滤 HTML 或 XML 文档 。

导入beautifulsoup4包

from bs4 import BeautifulSoup

获得HTML

html_doc = browser.page_source # 来自selenium的browsersoup = BeautifulSoup(html_doc, 'html.parser')

多种解析HTML方式

| 解析器 | 构建一个BeautifulSoup对象 | 速度 | 优势 | 劣势 |

|---|---|---|---|---|

| 语法 | soup = BeautifulSoup(解析内容,解析器) |

/ | / | / |

| python标准库 | soup = BeautifulSoup(html_doc, 'html.parser') |

适中 | Python的内置标准库 | Python 2.7.3or 3.2.2)前的版本中文档容错能力差 |

| lxml HTML 解析器 | soup = BeautifulSoup(html_doc, 'lxml') |

快 | 文档容错能力强 | 需要安装C语言库 |

| lxml XML 解析器 | soup = BeautifulSoup(html_doc, 'lxml-xml') |

快 | 唯一支持XML的解析器 | 需要安装C语言库 |

| lxml XML 解析器 | soup = BeautifulSoup(html_doc, 'xml') |

快 | 唯一支持XML的解析器 | 需要安装C语言库 |

| html5lib | soup = BeautifulSoup(html_doc, 'html5lib') |

慢 | 容错好、以浏览器的方式解析文档、生成HTML5格式 | 不依赖外部扩展 |

概念:2个类型<class 'bs4.element.ResultSet'><class 'bs4.element.Tag'>

使用html解析库 beautifulsoup4例子

<!DOCTYPE html><html><head><meta charset="utf-8"><title>标题</title></head><body><div id="div_data"><h1>我的第一个标题h1</h1><p class="p_class">我的第一个段落。p</p></div><div><a>第一个a标签</a><a>第二个a标签</a><p id="link1"></p></div></body></html>

获得soup后方法

| 查改增删 | 方法 | 释义 | 值 |

|---|---|---|---|

| 查 | soup.title |

获取整个title标签字段 | <title>标题</title> |

| 查 | soup.title.string |

获取title标签的值 | 标题 |

| 查 | soup.title.name |

获取title标签名称 | title |

| 查 | soup.title.parent.name |

获取 title 的父级标签名称 | head |

| 查 | soup.p |

获取第一个p标签字段 | <p class="p_class">我的第一个段落。p</p> |

| 查 | soup.p['class'] |

获取第一个p中class属性值 | ['p_class'] |

| 查 | soup.p.get('class') |

获取第一个p中class属性值 | ['p_class'] |

| 查 | soup.a |

获取第一个a标签字段 | <a>第一个a标签</a> |

| 查 | soup.find(id="link1") |

获取属性id值为link1的字段 | <p id="link1"></p> |

| 查 | soup.find_all('a') |

获取所有a标签字段 | [<a>第一个a标签</a>, <a>第二个a标签</a>] |

| 查 | soup.select("#div_data") |

[<div id="div_data"><h1>我的第一个标题h1</h1><p class="p_class">我的第一个段落。p</p></div>] |

|

| 查 | soup.select("#div_data")[0] |

<div id="div_data"><h1>我的第一个标题h1</h1><p class="p_class">我的第一个段落。p</p></div> |

|

| 查 | str(soup.select("#div_data")[0]) |

<div id="div_data"><h1>我的第一个标题h1</h1><p class="p_class">我的第一个段落。p</p></div> |

|

| 改 | soup.a['class'] = "newClass" |

可以对这些属性和内容等等进行修改 | |

| 删 | del soup.a['class'] |

还可以对这个属性进行删除 |

<class 'bs4.element.ResultSet'>

# 特征:# 有[]page_list = soup.select(".classname") # 获得class里的内容# page_list类型:<class 'bs4.element.ResultSet'>for a in page_list[0]: # 可以直接for,[0]是page_list是列表# 为了不用找来找去# 建议用这个取值方法data = a.find_all(name="div", attrs={"class": "class_name"})[0].string# find_all() # name参数填比较好,返回列表,标签之间的值# 去掉注释内容price = soup.find(name="div", attrs={"class": "class_name"})# price类型:<class 'bs4.element.Tag'>for element in price(text=lambda text: isinstance(text, Comment)):element.extract()price2 = price.string# 清空.clear()# 清除标签内的内容(包括子标签和文本)html = "<html><body><p><a></a></p></body></html>"soup.p.clear()# <html><body><p></p></body></html># 清空.decompose()# 清除标签(包括该标签)的内容(包括子标签和文本)html = "<html><body><p><a></a></p></body></html>"soup.p.decompose()# <html><body></body></html># 清空.extract()# 清除标签(包括该标签)的内容(包括子标签和文本)并返回# 同decompose,但是会返回删除的节点html = "<html><body><p><a></a></p></body></html>"p_extract = soup.p.extract()# <html><body></body></html># p_extract:<p><a></a></p>

<class 'bs4.element.Tag'>

# 特征# 无[]price = price.get_text() # 取值price = price["id"] # 属性值price = price["class"] # 属性值price = price["href"] # 属性值